(Link al artículo publicado)

Los físicos de partículas llamamos Bosones Vectoriales a

las partículas fundamentales que median entre las interacciones de la

materia corpuscular.

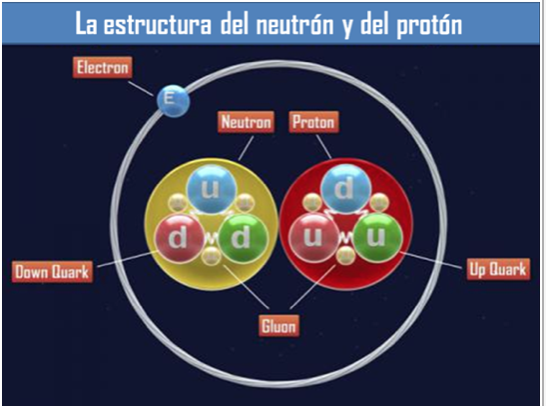

Estamos

hechos de quarks y leptones: los núcleos de los átomos están formados

de quarks “up” y “down” y junto con el electrón, que es un leptón,

forman el átomo.

Pero estas partículas de materia necesitan fuerzas que las mantengan unidas.

Según el intercambio de bosones vectoriales producido, existen tres tipos distintos de fuerzas:

-

·Electromagnética, si las partículas intercambiadas son fotones.

-

·Fuerte, que mantiene a los quarks juntos dentro del núcleo, si el intercambio entre ellos son gluones.

-

·Débil,

de vital importancia para nuestra vida por estar presente en todos los

procesos nucleares de fusión del sol, si el intercambio son W o Z.

Entender

los mecanismos de intercambio que intervienen en procesos de producción

y desintegración es de crucial importancia para la teoría del modelo

estándar de partículas.

Desde

los años 70-80 del siglo pasado, estos procesos se han estudiado

detalladamente y se han hecho muchas medidas de alta precisión que

están de acuerdo con las predicciones que esta teoría hace, dándonos

confianza en que nuestro entendimiento de la teoría electrodébil es

correcta en los mecanismos que podemos estudiar con los datos que nos

proporciona el acelerador LHC.

Gracias a estos estudios sabemos cómo y con qué tasa se

desintegran estas partículas, y eso nos da una pista de cómo buscarlas

en nuestros detectores.

Por ejemplo:

-

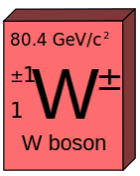

·El

bosón W se desintegra un 67% en quarks produciendo cascadas de

partículas en el detector, un 11% se desintegra a un par

electrón-neutrino, y el resto a leptones, concretamente en muón y tau

(que son como el electrón pero más pesadas) y sus compañeros los

neutrinos .

-

-

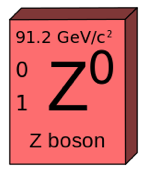

·El

bosón Z siempre se desintegra a un par de partículas iguales pero con

cargas opuestas: un 70% lo hace en un par de quarks (quark-antiquarks), y

el resto a un par de leptones, electron-positron, muon-antimuon,

tau-antitau o neutrino-antineutrino.

-

Hay muchas formas de buscar a los bosones vectoriales y

de comprobar todos los cálculos y predicciones de la teoría

electrodébil del modelo estándar.

Desde principios de este siglo, se está estudiando la producción de dos bosones vectoriales:

(WW, WZ, ZZ, Wg, Zg, gg).

La

situación es mucho más complicada porque su producción es menor, es

decir, la probabilidad de producir dos bosones en vez de uno es mucho

más baja, y además las combinaciones de desintegración de estas

partículas se multiplican por dos. De este modo nosotros, los

experimentales, tenemos muchas formas de distinguirlos en el detector y

de comprobar la teoría. Estos procesos son muy interesantes al ser un

test muy importante para la teoría, y además estudiando estos procesos

se puede medir con precisión la interacción entre los propios bosones,

predichos por la teoría, y que hasta ahora tienen muy poca precisión.

Por lo tanto, estos estudios pueden descifrar la propia estructura de

estas interacciones.

Poder

medir con mucha precisión la producción de estos procesos de dibosones y

las distintas características de ellos, además de para testar el modelo

estándar, sirve para detectar desviaciones de lo predicho dentro de

esta teoría, lo que puede significar que estamos viendo física nueva, es

decir fenómenos que son explicados por alguna teoría distinta a la que

tenemos hasta ahora.

Además

de ser interesantes en sí mismos, entender estos procesos es de vital

importancia cuando hacemos análisis de datos para estudiar el Higgs o

procesos descritos en alguna teoría de física nueva, como la

SuperSimetria o modelos que describen la materia oscura entre otros.

En

el IFCA estamos estudiando dos de estos procesos, WZ y WW, cuando los

dos W/Z se desintegran a leptones (electrones o muones y neutrinos).

Recientemente,

hemos hecho un análisis para estudiar la probabilidad de producción de

dos bosones W cuando chocamos dos protones con una energía disponible de

13 TeV y que será publicada en una revista de primer nivel dentro de

nuestro área. Estos datos fueron recogidos por el detector CMS, durante

el año 2015.

Durante

este año hemos estudiado todos los posibles candidatos, tratando de

distinguir los sucesos reales de otros procesos que los imitan mediante

una cuidada selección que optimiza el rechazo de estos últimos mientras

trata de conservar todos los verdaderos. Aún así, todos los procesos

falsos no se pueden rechazar y por lo tanto tenemos que encontrar

distintos modos de estimar la cantidad de ellos que todavía permanecen

en nuestras muestras.

Otra parte

muy importante es entender las características instrumentales del

detector: la eficiencia que tiene, la sensibilidad a las distintas

medidas de energía, momento, posición, identificación y estimar las

incertidumbres que tenemos en todas las medidas y que afectan a la

medida final.

La medida obtenida tiene un error del 10% y está de acuerdo con la teoría del modelo estándar.

El error en la medida se mejorará con más estadística; esto es muy

importante para poder probar el modelo estándar hasta sus últimas

consecuencias y también buscar por nueva física (como ya se dijo antes).

Ahora empezamos la toma de datos del 2016 que continuará hasta finales

de año y se espera tener aproximadamente un factor 10 mas de datos que

los que tenemos. Esta medida ya fue realizada a una energía de 8 TeV,

con un resultado que también era consistente con las predicciones

teóricas.

Este

análisis de datos para obtener el resultado final ha sido hecho en

conjunto con otros grupos nacionales como Universidad de Oviedo e

internacionales como ETH Zurich (Suiza), Fermi National Acelerador

Laboratory, Chicago (EEUU), Massachusetts Institute of Technology (MIT),

Boston (EEUU), National Taiwan University (Taiwan), Kyungpook National

University (Korea), Northeaster University (EEUU), University of

California at San Diego (UCSD), San Diego (EEUU), University of

California at Santa Barbara (UCSB), Santa Barbara (EEUU), Kansas

University, Kansas (EEUU), Punjab University, Chandigarh (India),

University of Antwerpen (Belgium), University and INFN Firenze (Italy).

Esto

puede parecer fácil, pero si tenemos en cuenta que guardamos del orden

de 150 colisiones por segundo y que el acelerador está tomando datos

durante meses casi sin parar, tenemos una cantidad ingente de choques,

de los cuales muy pocos producen el proceso que buscamos.

La

optimización de la selección es esencial para tener una buena medida, y

estudiar el rendimiento del detector para nuestra señal es crucial, pues

necesitamos saber con la mejor precisión posible qué eficiencia de

detección tenemos para cada unos de los objetos reconstruidos, leptones,

neutrinos, quarks, etc. Además, para uno de los cortes de la selección

tenemos que estimar cada uno de los procesos que imitan nuestra señal

para poderlos restar de nuestra muestra, estudiar todas las fuentes de

error que van a afectar a nuestra medida y, por último, entender qué

teoría estamos usando para que la comparación con nuestra medida sea

apropiada.

Cada una

de estas tareas lleva mucho tiempo y esfuerzo por parte de todos, así

que lo que hacemos es dividir las distintas tareas entre todo el equipo

y reunirnos periódicamente para ver los avances y discutir sobre los

siguientes pasos y dudas que tenemos.

Además

de esta gente que hacemos este análisis en particular, todos los

integrantes de la colaboración CMS, en la que nosotros trabajamos y que

tiene más de 3000 personas trabajando, participan de este análisis, pues

todos son necesarios para hacer posible el análisis de datos.

¿Por qué se necesita tanta gente para hacer el análisis de datos?

El

detector es una aparato de 20 metros de alto por 40 metros de largo

formado por muchos subdetectores, construidos con diferentes tecnologías

para darnos las características de las partículas que se producen en

cada colisión de la manera mas precisa posible; y también nos permite

seleccionar y guardar en discos para analizar solamente aquellas

colisiones que son interesantes para nosotros y ¨tira a la basura¨

aquellos que ya no lo son porque han sido estudiados en otros

experimentos anteriormente.

Esta

elección de colisiones interesantes se hace en tiempo real: el detector

por si solo usa tanto hardware como algoritmos de selección diseñados

especialmente para esto, con un diseño acorde para facilitar el análisis

de datos al tener en cuenta que hay choques cada 0,000000025 s.

Además,

todos los subdetectores tienen que estar calibrados y alineados unos con

respecto a otros para dar el mejor rendimiento.

En

resumen, millones de canales electrónicos de lectura tienen que ser

leídos como un total para reconstruir las partículas que salen de cada

choque y darnos las características de cada una de ellas: energía,

posición, dirección e identificación… (si es posible).

Por

ello se necesita una colaboración tan numerosa: todos los participantes

tienen que realizar distintas labores que aseguren la construcción y

mantenimiento de cada uno de los subdetectores y se calibren y alineen,

además de que se realicen correctamente la toma de datos y podamos

asegurar que las partículas que identificamos son correctas. Como los

datos que usamos para hacer los distintos análisis particulares dependen

de que este trabajo esté hecho correctamente, todas las personas que

trabajamos en estas tareas tenemos que aparecer en todos y cada uno de

los análisis que publica CMS como colaboración.